KI 1. Bundesliga Tipps simuliert: Monte-Carlo-Methoden in der Spielprognose

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Die Vorhersage von Fußballergebnissen ist von Natur aus mit Unsicherheit behaftet. Ein einzelnes Spiel kann trotz klarer Favoritenstellung anders ausgehen als erwartet, und selbst die beste Analyse kann nicht garantieren, welches Team am Ende gewinnt. Die Simulationsmethodik begegnet dieser Unsicherheit auf elegante Weise: Statt ein einzelnes Ergebnis vorherzusagen, werden tausende möglicher Spielverläufe durchgerechnet und deren Wahrscheinlichkeitsverteilung analysiert.

Dieser Artikel erklärt dir, wie Simulationen in der Bundesliga-Prognose funktionieren, was Monte-Carlo-Methoden sind und wie du die Ergebnisse solcher Analysen interpretieren kannst. Das Ziel ist nicht, dich zum Statistiker auszubilden, sondern ein konzeptionelles Verständnis zu vermitteln, das dir hilft, simulationsbasierte Prognosen einzuordnen und sinnvoll zu nutzen.

Was Spielsimulationen leisten und wie sie funktionieren

Der Grundgedanke einer Simulation ist die Nachahmung realer Prozesse durch computergestützte Modelle. Im Kontext der Fußballprognose bedeutet das, dass ein Algorithmus ein Spiel virtuell durchspielt, basierend auf den bekannten Eigenschaften der beteiligten Mannschaften und unter Berücksichtigung zufälliger Faktoren.

Eine einzelne Simulation liefert ein konkretes Ergebnis, etwa 2:1 für die Heimmannschaft. Dieses Ergebnis ist jedoch nur einer von vielen möglichen Ausgängen. Die Stärke der Simulationsmethodik liegt darin, den Prozess viele Male zu wiederholen. Wenn ein Spiel zehntausendmal simuliert wird, entsteht eine Verteilung aller möglichen Ergebnisse mit ihren jeweiligen Häufigkeiten. Diese Verteilung ist informativer als eine einzelne Punktprognose.

Die Simulation berücksichtigt dabei die statistische Natur des Fußballs. Die Torerzielung wird typischerweise als zufälliger Prozess modelliert, bei dem die Wahrscheinlichkeit eines Tores von der Stärke der Mannschaften abhängt. In jeder Simulation entscheidet ein Zufallsgenerator, ob und wann Tore fallen, wobei die zugrundeliegenden Wahrscheinlichkeiten aus historischen Daten abgeleitet werden.

Die Qualität einer Simulation hängt von der Güte des zugrundeliegenden Modells ab. Ein einfaches Modell könnte nur die durchschnittliche Torquote beider Teams berücksichtigen. Ein fortgeschrittenes Modell integriert Expected Goals, Formkurven, Heimvorteil, Personalien und weitere Faktoren. Je realistischer das Modell die relevanten Einflüsse erfasst, desto aussagekräftiger sind die Simulationsergebnisse.

Verschiedene Simulationsansätze im Vergleich

Nicht alle Simulationen sind gleich aufgebaut. Die verschiedenen Ansätze haben unterschiedliche Stärken und Schwächen, die für die Interpretation der Ergebnisse relevant sind.

Der einfachste Ansatz ist die ergebnisbasierte Simulation. Sie modelliert nur das Endergebnis, ohne den Spielverlauf zu berücksichtigen. Basierend auf den erwarteten Torzahlen beider Teams werden zufällige Ergebnisse generiert. Dieser Ansatz ist rechnerisch effizient und für viele Zwecke ausreichend, erfasst aber keine Dynamik innerhalb des Spiels.

Spielverlaufssimulationen gehen einen Schritt weiter und modellieren den zeitlichen Ablauf. Das Spiel wird in Intervalle unterteilt, etwa Minuten oder Fünf-Minuten-Blöcke, und für jedes Intervall wird die Wahrscheinlichkeit von Toren berechnet. Dieser Ansatz ermöglicht die Berücksichtigung von Spielstandseffekten, etwa dass ein Team bei Rückstand offensiver spielt und dadurch sowohl mehr Tore erzielt als auch mehr kassiert.

Ereignisbasierte Simulationen modellieren einzelne Spielaktionen wie Pässe, Torschüsse oder Zweikämpfe. Diese granulare Ebene ermöglicht die Integration von Spielerindividualität und taktischen Mustern. Die Komplexität solcher Modelle ist allerdings erheblich höher, und die Datenbasis für die Kalibrierung ist dünner.

Agentenbasierte Simulationen modellieren jeden Spieler als eigenständigen Entscheidungsträger mit individuellen Eigenschaften und Verhaltensregeln. Diese Methodik aus dem Bereich der künstlichen Intelligenz ermöglicht theoretisch die realistischste Abbildung des Spielgeschehens, ist aber für Prognosezwecke oft zu komplex und zu rechenintensiv.

Für die praktische Nutzung von Bundesliga-Prognosen sind ergebnisbasierte oder einfache spielverlaufsbasierte Simulationen am relevantesten. Sie bieten einen guten Kompromiss zwischen Aussagekraft und Handhabbarkeit. Fortgeschrittenere Methoden sind eher im akademischen Bereich oder bei professionellen Analysten zu finden.

Die Monte-Carlo-Methode erklärt

Der Begriff Monte-Carlo-Methode bezeichnet eine Klasse von Algorithmen, die Zufallszahlen verwenden, um komplexe Probleme zu lösen. Der Name stammt vom berühmten Casino in Monaco und verweist auf die zentrale Rolle des Zufalls in dieser Methodik.

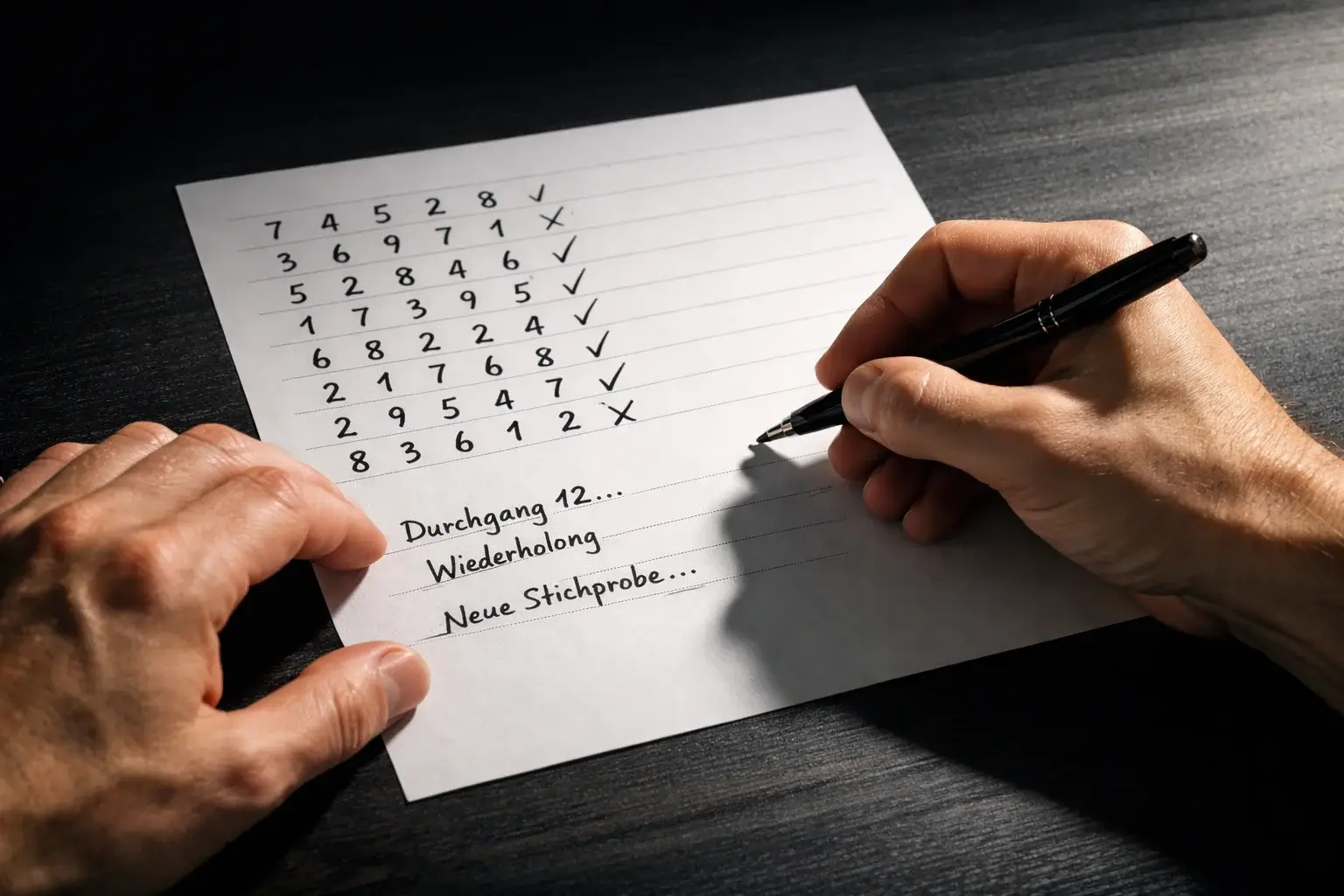

Die grundlegende Idee ist überraschend einfach. Wenn ein Problem zu komplex ist, um es analytisch zu lösen, kann man stattdessen viele zufällige Stichproben ziehen und aus deren Verteilung Rückschlüsse ziehen. Im Fußballkontext bedeutet das: Statt zu versuchen, die exakte Wahrscheinlichkeit für jeden möglichen Spielausgang zu berechnen, simuliert man das Spiel viele Male und zählt, wie oft jedes Ergebnis auftritt.

Die Genauigkeit der Monte-Carlo-Methode steigt mit der Anzahl der Durchläufe. Hundert Simulationen geben einen groben Überblick, zehntausend Simulationen liefern eine präzisere Verteilung. Die modernen Computerkapazitäten ermöglichen problemlos Millionen von Durchläufen, sodass die statistische Unsicherheit der Simulation selbst vernachlässigbar klein wird.

Ein entscheidender Vorteil der Monte-Carlo-Methode ist ihre Flexibilität. Sie kann auf praktisch jedes Modell angewendet werden, unabhängig von dessen Komplexität. Ob das zugrundeliegende Modell drei oder dreißig Variablen berücksichtigt, der Simulationsalgorithmus bleibt im Prinzip gleich. Das ermöglicht die Integration beliebig vieler Faktoren, ohne dass die mathematische Komplexität explodiert.

Die Methode hat ihren Ursprung in der Physik und wurde während des Zweiten Weltkriegs für die Entwicklung der Atombombe eingesetzt. Heute findet sie Anwendung in zahllosen Bereichen, von der Finanzwirtschaft über die Wettervorhersage bis zur Spielprognose. Im Fußball hat sie sich als besonders nützlich erwiesen, weil sie die inhärente Unsicherheit des Sports explizit abbildet.

Wie KI-Tools Bundesliga-Spiele simulieren

Die konkrete Implementierung von Simulationen für Bundesliga-Prognosen variiert zwischen verschiedenen Anbietern, folgt aber typischen Grundmustern.

Der Ausgangspunkt ist die Schätzung der erwarteten Torzahlen für beide Mannschaften. Diese Schätzung basiert auf historischen Daten, aktueller Form, Expected-Goals-Werten und weiteren relevanten Faktoren. Das Ergebnis sind zwei Zahlen, etwa 1,8 erwartete Tore für das Heimteam und 1,2 für das Auswärtsteam. Diese Werte sind keine Vorhersagen konkreter Ergebnisse, sondern Parameter für die Wahrscheinlichkeitsverteilung.

Die Torerzielung wird dann als Poisson-Prozess modelliert. Die Poisson-Verteilung beschreibt die Wahrscheinlichkeit für eine bestimmte Anzahl von Ereignissen in einem festen Zeitraum, wenn diese Ereignisse unabhängig und mit konstanter Rate auftreten. Tore im Fußball passen gut zu diesem Modell, auch wenn die Annahmen nicht perfekt erfüllt sind.

In jeder Simulation wird für jede Mannschaft eine zufällige Torzahl aus der jeweiligen Poisson-Verteilung gezogen. Bei einem erwarteten Wert von 1,8 Toren sind null, ein, zwei oder drei Tore jeweils plausible Ergebnisse, mit unterschiedlichen Wahrscheinlichkeiten. Die Kombination der beiden gezogenen Werte ergibt das simulierte Spielergebnis.

Fortgeschrittene Modelle erweitern diesen Grundansatz auf verschiedene Weisen. Sie können Korrelationen zwischen den Torerzielungen beider Teams berücksichtigen, etwa wenn offensive Spielweisen beider Mannschaften zu mehr Toren auf beiden Seiten führen. Sie können die Torwahrscheinlichkeit über den Spielverlauf variieren, um taktische Anpassungen bei Rückstand oder Führung zu modellieren. Sie können sogar einzelne Spielminuten simulieren statt nur das Endergebnis.

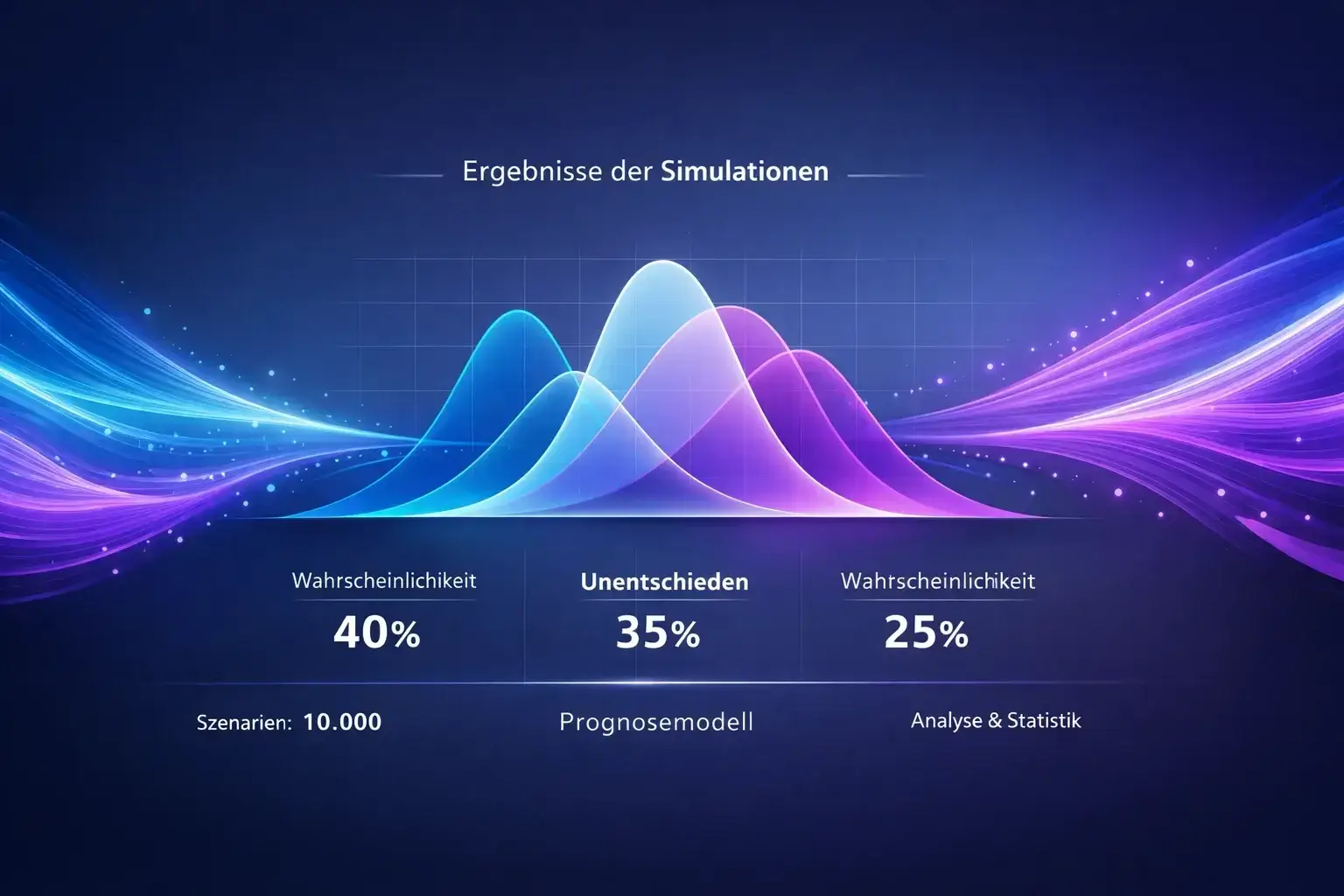

Die Aggregation vieler Simulationsdurchläufe liefert schließlich die Ergebnisverteilung. Wenn bei zehntausend Durchläufen fünftausendmal das Heimteam gewonnen hat, zweitausendmal das Spiel unentschieden endete und dreitausendmal das Auswärtsteam gewann, entspricht das Wahrscheinlichkeiten von 50 Prozent, 20 Prozent und 30 Prozent für die drei Ausgänge.

Simulation versus Punktprognose

Die Unterscheidung zwischen simulationsbasierten Wahrscheinlichkeiten und einfachen Punktprognosen ist fundamental für das Verständnis moderner Analysemethoden.

Eine Punktprognose sagt ein konkretes Ergebnis voraus, etwa Bayern gewinnt 2:1. Diese Aussage ist einfach zu verstehen und zu kommunizieren, aber sie verschweigt die Unsicherheit der Vorhersage. Sie suggeriert eine Gewissheit, die nicht existiert. Wenn das Spiel anders ausgeht, erscheint die Prognose als falsch, obwohl sie möglicherweise eine vernünftige Einschätzung war.

Eine simulationsbasierte Prognose liefert stattdessen eine Wahrscheinlichkeitsverteilung. Sie sagt etwa, dass Bayern mit 65 Prozent Wahrscheinlichkeit gewinnt, ein Unentschieden 20 Prozent Wahrscheinlichkeit hat und der Gegner mit 15 Prozent Wahrscheinlichkeit gewinnt. Das wahrscheinlichste Ergebnis ist 2:1 mit 12 Prozent, gefolgt von 1:0 mit 11 Prozent und 2:0 mit 10 Prozent. Diese Darstellung ist ehrlicher und informativer.

Der Informationsgewinn durch Simulationen liegt in der expliziten Darstellung der Unsicherheit. Du siehst nicht nur, was am wahrscheinlichsten ist, sondern auch, wie groß die Bandbreite möglicher Ausgänge ist. Ein Spiel mit 50/25/25-Verteilung (Heimsieg/Unentschieden) ist fundamental anders als eines mit 80/15/5-Verteilung, auch wenn in beiden Fällen der Heimsieg am wahrscheinlichsten ist.

Für die praktische Nutzung bieten Simulationsergebnisse einen direkten Vergleich mit Marktquoten. Die Quote eines Buchmachers spiegelt eine implizite Wahrscheinlichkeit wider. Wenn die Simulation eine höhere Wahrscheinlichkeit berechnet als die Quote impliziert, könnte ein Wertunterschied vorliegen. Diese Analyse ist mit Punktprognosen nicht möglich.

Praktische Beispiele für Simulationsergebnisse

Konkrete Beispiele machen die Interpretation von Simulationsergebnissen greifbarer und zeigen, wie die Methodik in der Praxis angewendet wird.

Betrachte ein hypothetisches Spiel zwischen einem Tabellenführer und einem Mittelklasseteam. Die Simulation könnte folgende Verteilung liefern: Heimsieg 58 Prozent, Unentschieden 24 Prozent, Auswärtssieg 18 Prozent. Die drei wahrscheinlichsten Einzelergebnisse wären 2:1 mit 13 Prozent, 1:1 mit 11 Prozent und 2:0 mit 10 Prozent. Die Wahrscheinlichkeit für mehr als 2,5 Tore läge bei 52 Prozent.

Diese Zahlen zeigen mehrere wichtige Punkte. Der Favorit ist zwar klar erkennbar, aber ein Überraschungsergebnis ist keineswegs unwahrscheinlich. Die kombinierte Wahrscheinlichkeit für Unentschieden oder Auswärtssieg beträgt 42 Prozent, also fast die Hälfte aller möglichen Ausgänge. Das wahrscheinlichste Einzelergebnis hat nur 13 Prozent Wahrscheinlichkeit, was bedeutet, dass es in 87 von 100 simulierten Spielen anders ausgeht.

Ein anderes Beispiel zeigt ein Abstiegsduell zwischen zwei Mannschaften aus dem Tabellenkeller. Die Simulation könnte hier eine ausgeglichenere Verteilung liefern: Heimsieg 38 Prozent, Unentschieden 30 Prozent, Auswärtssieg 32 Prozent. Die Torerwartung wäre mit 2,3 Toren insgesamt niedriger als im ersten Beispiel, weil beide Teams defensiver eingestellt sind.

Die Unterschiede zwischen beiden Beispielen illustrieren, wie Simulationen die Charakteristik verschiedener Spieltypen erfassen. Das Favoritenspiel hat eine breitere Ergebnisstreuung mit höherer Torerwartung, das Kellerduell ist enger mit weniger Toren. Diese Unterscheidung ist für die Bewertung von Wettmärkten relevant, weil sie zeigt, wo die tatsächlichen Chancen liegen.

Die Veränderung von Simulationsergebnissen im Zeitverlauf ist ein weiterer praktischer Aspekt. Wenn am Freitag vor dem Spieltag bekannt wird, dass der Toptorjäger des Favoriten verletzt fehlt, verschieben sich die Wahrscheinlichkeiten. Die aktualisierte Simulation könnte dann nur noch 52 Prozent für den Heimsieg zeigen statt 58 Prozent. Diese Reaktion auf neue Informationen ist eine Stärke der Simulationsmethodik.

Treue Verteilungen sind ver.

Das Lesen und Verstehen von Wahrscheinlichkeitsverteilungen ist eine Kernkompetenz für die Nutzung von Simulationsergebnissen.

Die grundlegendste Verteilung betrifft den Spielausgang: Heimsieg, Unentschieden oder Auswärtssieg. Diese drei Wahrscheinlichkeiten müssen sich zu hundert Prozent addieren. Eine typische Verteilung für ein ausgeglichenes Spiel könnte 40/30/30 sein, für ein klares Favoritenspiel eher 70/20/10. Die Form dieser Verteilung sagt viel über die Charakteristik des Spiels aus.

Die Ergebnisverteilung geht einen Schritt weiter und zeigt die Wahrscheinlichkeiten für konkrete Spielstände. Das häufigste Einzelergebnis hat selten mehr als 15 Prozent Wahrscheinlichkeit, selbst bei klaren Favoritenspielen. Das 1:1 ist in der Bundesliga statistisch das häufigste Ergebnis, aber selbst dieses tritt in weniger als zehn Prozent aller Spiele auf. Diese Streuung verdeutlicht, wie unsicher Ergebnisprognosen sind.

Die Torverteilung zeigt, wie viele Tore insgesamt erwartet werden. Simulationen können Wahrscheinlichkeiten für Over-Under-Märkte direkt liefern, etwa dass mit 55 Prozent Wahrscheinlichkeit mehr als 2,5 Tore fallen. Diese Informationen ergänzen die Ausgangsverteilung um eine zweite Dimension.

Die Interpretation muss die Natur von Wahrscheinlichkeiten berücksichtigen. Eine Wahrscheinlichkeit von 70 Prozent für den Heimsieg bedeutet, dass bei zehn vergleichbaren Spielen statistisch sieben mit Heimsieg enden würden, aber auch drei nicht. Das einzelne Spiel kann zu den dreißig Prozent gehören, ohne dass die Prognose falsch war. Diese Denkweise ist ungewohnt, aber essentiell für den sinnvollen Umgang mit Simulationsergebnissen.

Saisonverläufe simulieren

Die Anwendung von Monte-Carlo-Methoden ist nicht auf Einzelspiele beschränkt. Besonders interessant ist die Simulation ganzer Saisonverläufe.

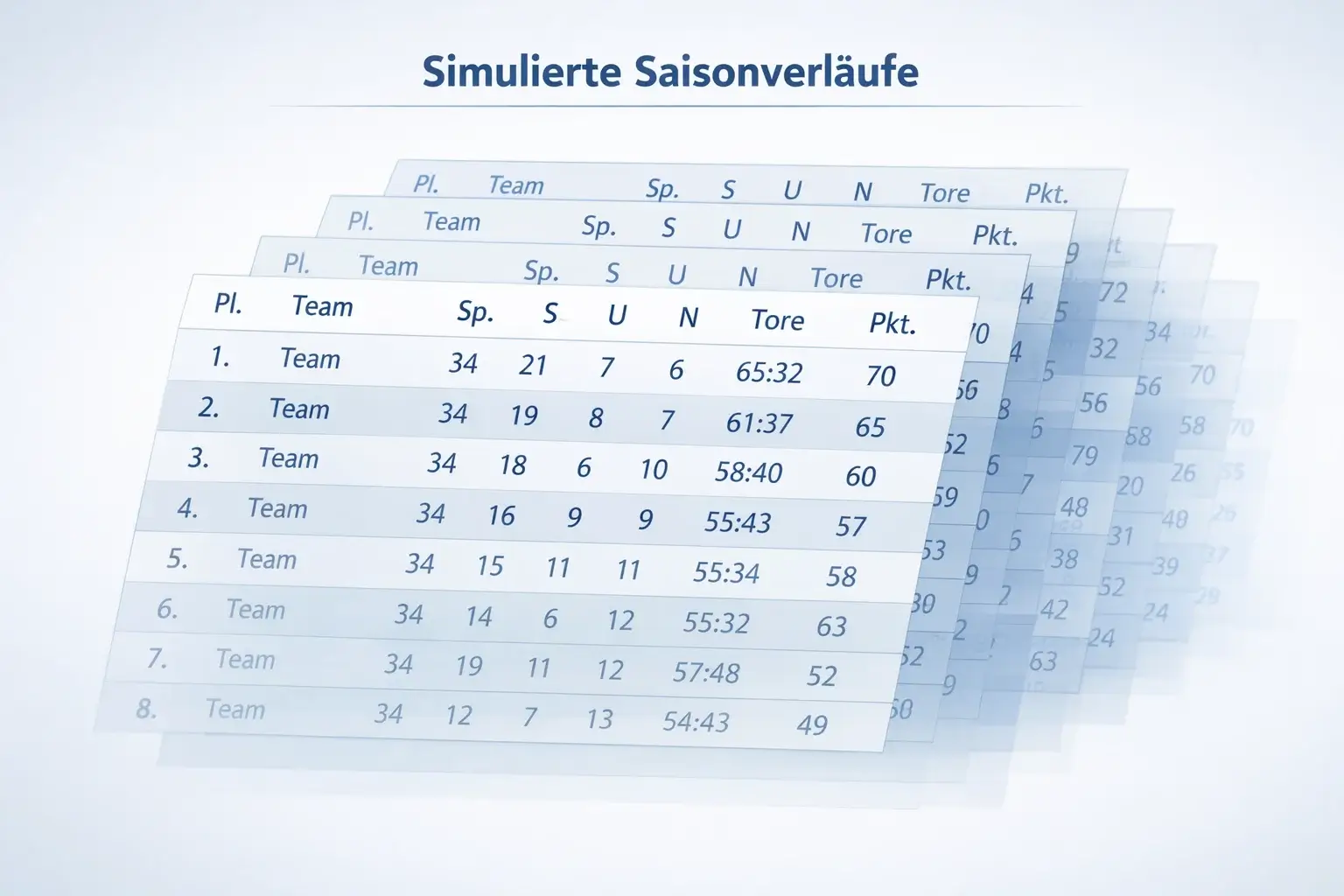

Eine Saisonsimulation führt die Einzelspielsimulationen für alle ausstehenden Partien durch und berechnet die resultierende Tabelle. Ein Durchlauf ergibt eine konkrete Endtabelle, zehntausend Durchläufe ergeben eine Verteilung möglicher Tabellenplatzierungen für jedes Team. Diese Methodik ermöglicht Aussagen wie Bayern hat eine Meisterschaftswahrscheinlichkeit von 68 Prozent oder Holstein Kiel hat ein Abstiegsrisiko von 42 Prozent.

Die Komplexität von Saisonsimulationen ist erheblich höher als bei Einzelspielen. Jeder Durchlauf erfordert die Simulation von dutzenden oder hunderten von Spielen, abhängig vom Zeitpunkt in der Saison. Die Ergebnisse früherer Spiele beeinflussen die Tabellensituation und damit möglicherweise auch die Motivation in späteren Spielen. Fortgeschrittene Modelle versuchen, diese Interdependenzen zu erfassen.

Die Aktualisierung von Saisonprognosen im Verlauf der Spielzeit zeigt die Dynamik der Wahrscheinlichkeiten. Zu Saisonbeginn hat der Favorit vielleicht 60 Prozent Meisterschaftswahrscheinlichkeit. Nach zehn Spieltagen mit Tabellenführung könnte dieser Wert auf 75 Prozent steigen. Nach einer Niederlagenserie könnte er wieder auf 50 Prozent fallen. Diese Veränderungen reflektieren den Informationsgewinn durch tatsächliche Ergebnisse.

Die Nutzung von Saisonsimulationen für Langzeitwetten erfordert Vorsicht. Die Unsicherheit akkumuliert sich über die vielen ausstehenden Spiele, und kleine Fehler im Modell können zu erheblichen Abweichungen in der Endtabelle führen. Saisonprognosen sind weniger belastbar als Einzelspielprognosen, auch wenn sie methodisch auf denselben Grundlagen basieren.

Validierung von Simulationsmodellen

Die Qualität einer Simulation lässt sich durch verschiedene Methoden überprüfen. Diese Validierung ist wichtig, um die Aussagekraft der Ergebnisse einschätzen zu können.

Die Kalibrierungsprüfung vergleicht die prognostizierten Wahrscheinlichkeiten mit den tatsächlichen Ergebnissen über viele Spiele hinweg. Wenn ein Modell für hundert Spiele jeweils 60 Prozent Heimsiegwahrscheinlichkeit angibt, sollten etwa sechzig dieser Spiele tatsächlich mit Heimsieg enden. Systematische Abweichungen deuten auf Kalibrierungsprobleme hin, etwa wenn das Modell Heimsiege konsistent über- oder unterschätzt.

Die Schärfe oder Discrimination misst, wie gut das Modell zwischen verschiedenen Spieltypen unterscheidet. Ein gutes Modell gibt für Favoritenspiele höhere Siegwahrscheinlichkeiten an als für ausgeglichene Duelle. Ein Modell, das für alle Spiele ähnliche Wahrscheinlichkeiten liefert, nutzt die verfügbare Information nicht effektiv, auch wenn es gut kalibriert sein mag.

Der Brier-Score kombiniert Kalibrierung und Schärfe zu einer einzigen Kennzahl. Er misst die mittlere quadratische Abweichung zwischen prognostizierten Wahrscheinlichkeiten und tatsächlichen Ergebnissen. Ein niedrigerer Brier-Score bedeutet bessere Prognosen. Diese Metrik ermöglicht den Vergleich verschiedener Modelle auf einer einheitlichen Skala.

Die Backtesting-Methodik testet das Modell auf historischen Daten. Die Simulation wird auf vergangene Spieltage angewendet, ohne die damaligen Ergebnisse zu kennen, und die Prognosegüte wird gemessen. Ein Modell, das im Backtesting gut abschneidet, ist nicht garantiert auch in Zukunft erfolgreich, aber es ist ein notwendiges Minimum für die Vertrauenswürdigkeit.

Für Nutzer von Simulationsprognosen ist die Frage der Validierung oft schwer zu beantworten, weil Anbieter selten transparente Validierungsergebnisse veröffentlichen. Ein seriöser Anbieter sollte zumindest grundlegende Kalibrierungsinformationen bereitstellen. Wenn diese fehlen, ist Vorsicht angebracht.

Grenzen und Schwächen von Simulationen

Trotz ihrer methodischen Eleganz haben Simulationen fundamentale Grenzen, die für eine realistische Nutzung verstanden werden müssen.

Die Qualität der Simulation ist durch die Qualität des zugrundeliegenden Modells begrenzt. Ein Modell, das wichtige Faktoren ignoriert oder falsch gewichtet, produziert systematisch verzerrte Ergebnisse, unabhängig davon, wie viele Simulationsdurchläufe durchgeführt werden. Die Simulation kann nur die Unsicherheit innerhalb des Modells abbilden, nicht die Unsicherheit des Modells selbst.

Die Annahme der Unabhängigkeit von Ereignissen ist oft vereinfachend. Die Poisson-Verteilung unterstellt, dass jedes Tor unabhängig von den vorherigen fällt. In der Realität beeinflussen Tore den Spielverlauf erheblich. Ein Team, das früh in Rückstand gerät, spielt anders als eines, das führt. Diese taktischen Anpassungen sind schwer zu modellieren.

Die historische Kalibrierung von Modellen garantiert nicht ihre Gültigkeit für die Zukunft. Ein Modell, das vergangene Saisons gut erklärt hat, kann in der aktuellen Saison versagen, wenn sich die Bedingungen geändert haben. Neue Taktiken, Regeländerungen oder außergewöhnliche Umstände können Muster brechen, die zuvor stabil erschienen.

Die Kommunikation von Simulationsergebnissen ist oft irreführend. Zahlen wie 67,3 Prozent Heimsiegwahrscheinlichkeit suggerieren eine Präzision, die nicht existiert. Die wahre Wahrscheinlichkeit könnte bei 60 oder 75 Prozent liegen, und niemand weiß es genau. Die scheinbare Genauigkeit ist ein Artefakt der Methodik, nicht ein Abbild der Realität.

Praktische Anwendung von Simulationsergebnissen

Die Nutzung simulationsbasierter Prognosen für eigene Entscheidungen erfordert einen strukturierten Ansatz.

Betrachte Simulationsergebnisse als einen Baustein deiner Analyse, nicht als alleinige Entscheidungsgrundlage. Die Zahlen liefern einen datenbasierten Referenzpunkt, den du mit deinem eigenen Wissen und deiner Beobachtung abgleichen kannst. Wenn Simulation und Intuition stark divergieren, ist das ein Anlass für vertiefte Überlegung.

Vergleiche die Simulationswahrscheinlichkeiten mit den Marktquoten. Rechne die Quoten in implizite Wahrscheinlichkeiten um und prüfe, ob die Simulation deutlich abweichende Werte liefert. Kleine Unterschiede sind nicht aussagekräftig, weil sie im Bereich der Modellungenauigkeit liegen. Größere Unterschiede könnten auf Wertdifferenzen hindeuten, sollten aber kritisch hinterfragt werden.

Achte auf die Unsicherheit der Simulationsergebnisse. Ein Spiel mit einer 55/25/20-Verteilung ist fundamental anders als eines mit 35/35/30. Im ersten Fall gibt es einen klaren Favoriten, im zweiten ist das Spiel offen. Diese Information ist oft wertvoller als die Frage, welcher Ausgang am wahrscheinlichsten ist.

Nutze Saisonsimulationen mit besonderer Vorsicht. Die Unsicherheit ist hier höher als bei Einzelspielen, und die Prognosen können sich im Saisonverlauf erheblich ändern. Langfristige Aussagen auf Basis früher Saisonsimulationen sind weniger belastbar als solche auf Basis aktueller Tabellensituationen.

Simulationen kritisch hinterfragen

Die kompetente Nutzung von Simulationsergebnissen erfordert eine kritische Grundhaltung gegenüber den präsentierten Zahlen.

Frage nach dem zugrundeliegenden Modell. Welche Faktoren fließen in die Simulation ein? Wie werden sie gewichtet? Wie aktuell sind die verwendeten Daten? Diese Informationen werden oft nicht transparent kommuniziert, sind aber entscheidend für die Einschätzung der Aussagekraft.

Sei skeptisch gegenüber scheinbarer Präzision. Zahlen mit Nachkommastellen suggerieren Genauigkeit, die in der Regel nicht existiert. Die Unterscheidung zwischen 64 und 66 Prozent Siegwahrscheinlichkeit ist praktisch bedeutungslos, weil beide Zahlen innerhalb des Konfidenzintervalls liegen.

Prüfe, ob die Simulation vergangene Ergebnisse korrekt einschätzt. Ein gutes Modell sollte bei historischen Spielen Wahrscheinlichkeiten geliefert haben, die mit den tatsächlichen Ergebnissen konsistent sind. Diese Kalibrierung ist ein Qualitätsmerkmal, das aber nicht immer dokumentiert wird.

Bedenke, dass der Markt selbst Simulationen nutzt. Die Buchmacherquoten reflektieren professionelle Analysen, die oft auf ähnlichen Methoden basieren. Ein systematischer Vorteil durch öffentlich verfügbare Simulationen ist unwahrscheinlich, weil die gleichen Informationen bereits in die Quoten eingeflossen sind.

Der Einfluss von Eingabeparametern auf Simulationsergebnisse

Die Sensitivität von Simulationen gegenüber ihren Eingabeparametern ist ein oft unterschätzter Aspekt, der die Robustheit der Ergebnisse beeinflusst.

Kleine Änderungen in den geschätzten Teamstärken können merkliche Verschiebungen in den Wahrscheinlichkeiten verursachen. Wenn die erwartete Torzahl eines Teams von 1,5 auf 1,7 angehoben wird, ändert sich die gesamte Ergebnisverteilung. Die Siegwahrscheinlichkeit könnte um mehrere Prozentpunkte steigen, was in einem umkämpften Markt relevant sein kann.

Die Unsicherheit der Eingabeparameter selbst wird selten kommuniziert. Die Schätzung der erwarteten Torzahlen basiert auf Modellen, die ihrerseits Unsicherheiten haben. Eine erwartete Torzahl von 1,6 könnte in Wirklichkeit irgendwo zwischen 1,3 und 1,9 liegen, und diese Bandbreite sollte sich in den Ergebnissen widerspiegeln.

Fortgeschrittene Simulationen berücksichtigen diese Parameterunsicherheit explizit. Statt mit festen Werten zu arbeiten, werden die Eingabeparameter selbst als Verteilungen modelliert. In jedem Simulationsdurchlauf werden zunächst die Parameter aus ihren Verteilungen gezogen und dann das Spiel simuliert. Diese zweistufige Methodik liefert realistischere Konfidenzintervalle.

Für die praktische Nutzung bedeutet das, dass kleine Unterschiede in Simulationsergebnissen nicht überbewertet werden sollten. Wenn zwei Modelle für dasselbe Spiel 62 und 58 Prozent Heimsiegwahrscheinlichkeit angeben, ist das kein bedeutsamer Unterschied, sondern liegt im Bereich der Parameterunsicherheit.

Verantwortungsvoller Umgang mit simulationsbasierten Prognosen

Die Verfügbarkeit von Simulationsergebnissen kann das Gefühl verstärken, die Unsicherheit des Fußballs beherrscht zu haben. Diese Illusion ist gefährlich.

Simulationen quantifizieren Unsicherheit, sie eliminieren sie nicht. Ein Spiel mit 70 Prozent Siegwahrscheinlichkeit für den Favoriten geht in drei von zehn Fällen anders aus. Diese Grundunsicherheit bleibt bestehen, egal wie ausgeklügelt das Modell ist.

Die Bundeszentrale für gesundheitliche Aufklärung bietet unter der Telefonnummer 0800 1 37 27 00 kostenlose und anonyme Beratung für Menschen, die ihr Spielverhalten reflektieren möchten. Wenn die Beschäftigung mit Prognosen und Wahrscheinlichkeiten mehr Raum einnimmt als beabsichtigt, ist professionelle Unterstützung verfügbar.

Monte-Carlo-Simulationen sind ein faszinierendes Werkzeug, das die Unsicherheit von Fußballprognosen explizit macht. Sie ersetzen nicht die Grundunsicherheit des Sports, sondern helfen, sie zu verstehen und einzuordnen. Mit dieser realistischen Perspektive kannst du die Möglichkeiten der Simulationsmethodik nutzen, ohne ihre Grenzen aus den Augen zu verlieren.