KI 1. Bundesliga Tipps statistisch: Die Grundlagen datenbasierter Spielanalyse

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Fußball ist ein Spiel voller Emotionen, Überraschungen und scheinbar unberechenbarer Momente. Dennoch verbergen sich hinter dem oberflächlichen Chaos Muster und Regelmäßigkeiten, die sich mit statistischen Methoden erfassen lassen. Die moderne KI-gestützte Spielanalyse basiert auf dieser Erkenntnis und versucht, aus der Fülle verfügbarer Daten Rückschlüsse auf zukünftige Ergebnisse zu ziehen.

Dieser Artikel vermittelt dir die statistischen Grundlagen, auf denen KI-Prognosen für die Bundesliga aufbauen. Du erfährst, welche Kennzahlen relevant sind, wie sie zusammenhängen und wo die Grenzen statistischer Analyse liegen. Dabei geht es nicht um mathematische Formeln, sondern um ein konzeptionelles Verständnis, das dir hilft, Prognosen kritisch einzuordnen und ihre Aussagekraft realistisch einzuschätzen.

Die Bedeutung von Statistik im modernen Fußball

Die Rolle von Statistik im Fußball hat sich in den letzten zwei Jahrzehnten grundlegend gewandelt. Was früher als Spielerei für Zahlenfreunde galt, ist heute ein zentraler Bestandteil der Analyse auf allen Ebenen, von Profivereinen über Medien bis zu interessierten Fans.

Diese Entwicklung wurde durch mehrere Faktoren vorangetrieben. Die Digitalisierung der Datenerfassung ermöglicht heute das Tracking jeder Spielerbewegung, jedes Passes und jedes Schusses. Wo früher nur Tore und Torschüsse gezählt wurden, entstehen heute pro Spiel tausende von Datenpunkten, die für Analysen zur Verfügung stehen. Die Bundesliga gehört zu den Ligen mit der fortschrittlichsten Dateninfrastruktur, was sie zu einem idealen Testfeld für statistische Methoden macht.

Die steigende Rechenleistung hat die Verarbeitung dieser Datenmengen erst ermöglicht. Algorithmen, die vor zwanzig Jahren Stunden für eine Analyse gebraucht hätten, liefern heute Ergebnisse in Sekundenbruchteilen. Diese Geschwindigkeit ermöglicht nicht nur tiefere Analysen, sondern auch die Echtzeitanwendung während laufender Spiele.

Der Erfolg datenbasierter Ansätze in anderen Sportarten hat den Fußball beeinflusst. Die Sabermetrics-Revolution im Baseball und die analytische Wende im Basketball haben gezeigt, dass statistische Methoden einen echten Wettbewerbsvorteil bieten können. Der Fußball mit seiner größeren Komplexität und geringeren Toranzahl war zunächst skeptischer, hat aber inzwischen aufgeholt.

Für KI-Prognosen ist diese statistische Grundlage unverzichtbar. Die Algorithmen lernen aus historischen Daten und identifizieren Muster, die für menschliche Analysten unsichtbar bleiben. Je besser die Datenqualität und je umfangreicher die historische Basis, desto präziser können die Prognosen sein. Die Bundesliga bietet hier hervorragende Voraussetzungen.

Verschiedene Datentypen in der Fußballanalyse

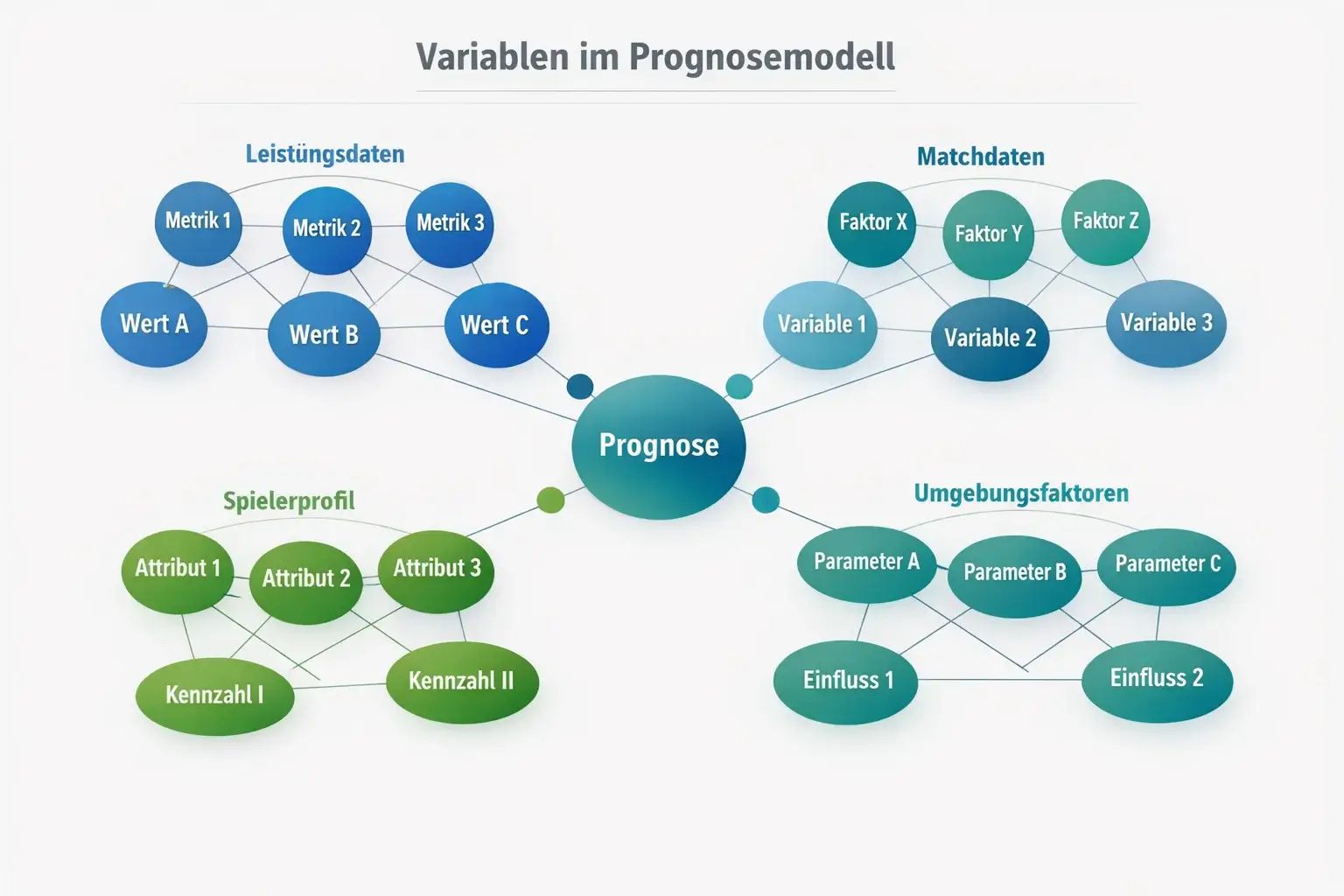

Die statistischen Daten, die für Bundesliga-Prognosen verwendet werden, lassen sich in verschiedene Kategorien einteilen, die jeweils unterschiedliche Aspekte des Spiels erfassen.

Ereignisdaten dokumentieren diskrete Vorkommnisse während eines Spiels. Tore, Torschüsse, Fouls, Eckbälle und Einwürfe fallen in diese Kategorie. Diese Daten sind seit Jahrzehnten verfügbar und bilden die traditionelle Grundlage der Fußballstatistik. Ihr Vorteil liegt in der Objektivität und der langen historischen Verfügbarkeit. Der Nachteil ist ihre begrenzte Tiefe, denn sie sagen wenig über die Qualität der erfassten Ereignisse aus.

Positionsdaten erfassen die räumliche Dimension des Spiels. Moderne Tracking-Systeme dokumentieren die Position jedes Spielers und des Balls mehrmals pro Sekunde. Aus diesen Daten lassen sich Laufwege, Raumaufteilung und taktische Formationen ableiten. Die Bundesliga nutzt seit Jahren fortschrittliche Tracking-Technologie, die präzise Positionsdaten für jedes Spiel liefert.

Kontextdaten ergänzen die spielbezogenen Informationen um Rahmenbedingungen. Wetter, Anstoßzeit, Tabellenstand, Verletzungslisten und historische Direktvergleiche fallen in diese Kategorie. Diese Faktoren beeinflussen die Spielergebnisse, ohne direkt aus dem Spielgeschehen abgeleitet zu sein. Ihre Integration in Prognosemodelle erfordert sorgfältige Überlegungen zur Relevanz und Gewichtung.

Aggregierte Metriken kombinieren Rohdaten zu aussagekräftigeren Kennzahlen. Expected Goals, Expected Assists und ähnliche Metriken gehören in diese Kategorie. Sie verdichten komplexe Informationen zu einzelnen Zahlen, die leichter interpretierbar sind als die zugrundeliegenden Rohdaten. Der Preis dieser Verdichtung ist der Verlust von Detailinformation.

Die Kombination verschiedener Datentypen ermöglicht umfassendere Analysen als die isolierte Betrachtung einzelner Kategorien. Ein fortgeschrittenes KI-Modell integriert Ereignisdaten, Positionsdaten und Kontextfaktoren zu einem ganzheitlichen Bild der Mannschaftsstärke. Diese Integration ist methodisch anspruchsvoll, weil die verschiedenen Datentypen unterschiedliche Eigenschaften und Unsicherheiten haben.

Welche Statistiken in KI-Modelle einfließen

Die Bandbreite der Statistiken, die moderne KI-Systeme verwenden, ist enorm. Von einfachen Kennzahlen wie Toren und Punkten bis zu komplexen Metriken wie Expected Goals oder Pressing-Intensität fließen dutzende von Variablen in die Analysen ein.

Ergebnisbasierte Statistiken bilden die Grundlage jedes Modells. Tore, Gegentore, Punkte und Tabellenposition sind die offensichtlichsten Indikatoren für die Stärke einer Mannschaft. Diese Zahlen haben den Vorteil der Objektivität und der langen historischen Verfügbarkeit. Der Nachteil liegt darin, dass sie stark von Zufallsfaktoren beeinflusst werden können. Ein Team kann mehrere Spiele gewinnen, obwohl es schlecht gespielt hat, oder umgekehrt trotz guter Leistung verlieren.

Leistungsbasierte Statistiken versuchen, diese Verzerrung zu korrigieren. Torschüsse, Ballbesitz, Passgenauigkeit und Zweikampfquoten messen die Spielleistung unabhängig vom Endergebnis. Ein Team mit hohem Ballbesitz und vielen Torschüssen hat in der Regel gut gespielt, auch wenn es nicht gewonnen hat. Diese Metriken geben ein vollständigeres Bild der tatsächlichen Stärke.

Fortgeschrittene Metriken wie Expected Goals (xG) kombinieren mehrere Faktoren zu aussagekräftigeren Kennzahlen. xG bewertet nicht nur die Anzahl der Torschüsse, sondern auch deren Qualität basierend auf Position, Winkel und Spielsituation. Diese Metriken haben in den letzten Jahren an Bedeutung gewonnen und sind heute ein Standardbestandteil professioneller Analysen.

Kontextuelle Faktoren ergänzen die rein spielbezogenen Statistiken. Die Heimspielquote, Leistungen gegen bestimmte Gegnertypen, Ergebnisse nach Länderspielpausen oder in englischen Wochen sind Beispiele für kontextuelle Variablen, die in KI-Modelle einfließen können. Diese Faktoren erfassen Aspekte, die in den reinen Spielstatistiken nicht sichtbar werden.

Finanzielle Kennzahlen spielen in manchen Modellen eine Rolle. Kaderwerte, Transferausgaben und Gehaltsbudgets korrelieren langfristig mit sportlichem Erfolg. Ein Team mit dreifachem Budget wird über eine Saison hinweg statistisch besser abschneiden als ein finanziell schwächerer Gegner, auch wenn Einzelspiele davon abweichen können.

Korrelation und Kausalität verstehen

Ein fundamentales Konzept für das Verständnis statistischer Analysen ist die Unterscheidung zwischen Korrelation und Kausalität. Diese Unterscheidung wird oft vernachlässigt, führt aber zu gravierenden Fehlinterpretationen, wenn sie ignoriert wird.

Korrelation beschreibt den statistischen Zusammenhang zwischen zwei Variablen. Wenn eine Variable steigt und eine andere ebenfalls steigt, besteht eine positive Korrelation. Im Fußball gibt es zahlreiche Korrelationen, etwa zwischen Ballbesitz und Punktausbeute oder zwischen Kaderwert und Tabellenplatz. Diese Zusammenhänge sind real und messbar.

Kausalität geht einen Schritt weiter und behauptet, dass eine Variable die andere verursacht. Hier liegt die Gefahr von Fehlschlüssen. Nur weil zwei Variablen korrelieren, bedeutet das nicht, dass eine die andere verursacht. Beide könnten von einer dritten Variable beeinflusst werden, oder der Zusammenhang könnte zufällig sein.

Ein Beispiel aus dem Fußball illustriert dieses Problem. Teams mit hohem Ballbesitz gewinnen statistisch häufiger. Daraus könnte man schließen, dass hoher Ballbesitz Siege verursacht. Die Realität ist komplexer. Gute Teams haben tendenziell mehr Ballbesitz, weil sie technisch versierter sind und besser pressen können. Der Ballbesitz ist also eher ein Symptom von Qualität als deren Ursache. Ein schwaches Team, das künstlich auf hohen Ballbesitz setzt, wird dadurch nicht automatisch erfolgreicher.

Für KI-Prognosen hat diese Unterscheidung praktische Konsequenzen. Modelle, die nur Korrelationen lernen, können in bestimmten Situationen versagen, wenn die zugrundeliegenden kausalen Mechanismen anders funktionieren als üblich. Robuste Modelle versuchen, echte kausale Zusammenhänge zu erfassen, was allerdings methodisch anspruchsvoll ist.

Die kritische Frage bei jeder Statistik lautet daher: Warum besteht dieser Zusammenhang? Die bloße Beobachtung einer Korrelation reicht nicht aus. Erst das Verständnis des Mechanismus dahinter ermöglicht eine fundierte Einschätzung, ob der Zusammenhang auch in Zukunft gelten wird.

Zentrale statistische Kennzahlen erklärt

Das Verständnis der wichtigsten statistischen Konzepte hilft dir, Prognosen einzuordnen und ihre Aussagekraft zu bewerten. Diese Grundlagen sind keine fortgeschrittene Mathematik, sondern intuitiv verständliche Ideen.

Der Durchschnitt oder Mittelwert ist die einfachste und bekannteste Kennzahl. Er gibt an, welcher Wert typischerweise zu erwarten ist. Der Tordurchschnitt der Bundesliga liegt beispielsweise bei etwa drei Toren pro Spiel. Dieser Wert ist ein nützlicher Referenzpunkt, sagt aber nichts über die Streuung um diesen Mittelwert aus.

Die Varianz und ihre Wurzel, die Standardabweichung, messen diese Streuung. Sie zeigen, wie stark einzelne Werte vom Durchschnitt abweichen. Eine hohe Varianz bedeutet, dass die Ergebnisse stark schwanken. Im Fußball ist die Varianz traditionell hoch, was Prognosen erschwert. Selbst wenn ein Team im Durchschnitt 1,5 Tore pro Spiel erzielt, kann es in einem einzelnen Spiel null oder vier Tore schießen.

Die Wahrscheinlichkeit quantifiziert die Erwartung für bestimmte Ereignisse. Eine Wahrscheinlichkeit von 60 Prozent für einen Heimsieg bedeutet, dass bei hundert vergleichbaren Spielen etwa sechzig mit einem Heimsieg enden würden. Wichtig ist das Verständnis, dass Wahrscheinlichkeiten keine Garantien sind. Ein Ereignis mit 30 Prozent Wahrscheinlichkeit tritt in drei von zehn Fällen ein, und das einzelne Spiel kann genau einer dieser drei Fälle sein.

Die Stichprobengröße beeinflusst die Zuverlässigkeit statistischer Aussagen. Eine Aussage, die auf fünf Spielen basiert, ist weniger belastbar als eine, die auf fünfzig Spielen basiert. Im Fußball ist die Stichprobengröße oft ein limitierender Faktor, weil eine Saison nur 34 Spieltage umfasst und sich Kader und Trainer regelmäßig ändern.

Die statistische Signifikanz gibt an, ob ein beobachteter Unterschied wahrscheinlich real ist oder durch Zufall entstanden sein könnte. Wenn ein Team in fünf Spielen drei Heimsiege und zwei Heimniederlagen hat, könnte das zufällig sein. Wenn es in fünfzig Spielen dreißig Heimsiege und zwanzig Heimniederlagen hat, ist der Trend wahrscheinlich real. KI-Modelle müssen diese Unsicherheit bei kleinen Stichproben berücksichtigen.

Statistische Muster in der Bundesliga

Die langjährige Analyse der Bundesliga hat charakteristische Muster offenbart, die für das Verständnis von Prognosen relevant sind. Diese Muster sind keine Naturgesetze, aber sie zeigen Tendenzen, die sich über viele Jahre als stabil erwiesen haben.

Die Torverteilung in der Bundesliga folgt annähernd einer Poisson-Verteilung. Diese mathematische Verteilung beschreibt die Wahrscheinlichkeit von seltenen Ereignissen in einem festen Zeitraum. Tore im Fußball passen gut zu diesem Modell, was die Berechnung von Wahrscheinlichkeiten für verschiedene Ergebnisse ermöglicht. Die durchschnittliche Toranzahl pro Spiel liegt bei etwa drei, mit einer charakteristischen Streuung um diesen Wert.

Der Heimvorteil ist ein statistisch messbares Phänomen, das allerdings in den letzten Jahren deutlich zurückgegangen ist. Historisch gewannen Heimmannschaften über fünfzig Prozent ihrer Spiele, während dieser Wert in jüngeren Saisons auf unter vierzig Prozent gefallen ist. Die Ursachen für diesen Rückgang sind vielfältig und umfassen bessere Reisebedingungen, professionellere Auswärtsvorbereitung und möglicherweise veränderte Taktiken. KI-Modelle müssen diesen Trend berücksichtigen und dürfen nicht auf veralteten Annahmen basieren.

Die Formkurve zeigt, dass aktuelle Ergebnisse bessere Prognosen ermöglichen als weit zurückliegende. Die Leistungen der letzten fünf Spiele sind informativer als die der ersten fünf Saisonspiele, weil sich Teams im Laufe einer Saison entwickeln. Moderne KI-Modelle gewichten aktuelle Daten stärker als historische, wobei die optimale Gewichtung empirisch bestimmt wird.

Die Regression zum Mittelwert ist ein statistisches Phänomen, das im Fußball regelmäßig zu beobachten ist. Teams, die deutlich über oder unter ihrem langfristigen Niveau abschneiden, tendieren dazu, zum Durchschnitt zurückzukehren. Ein Aufsteiger, der nach zehn Spieltagen überraschend an der Tabellenspitze steht, wird statistisch gesehen in der Rückrunde schwächer abschneiden. Dieses Muster ist nicht deterministisch, aber robust genug, um in Prognosen einzufließen.

Datenqualität und ihre Auswirkungen

Die Qualität der statistischen Analyse hängt fundamental von der Qualität der zugrundeliegenden Daten ab. Selbst die beste Methodik liefert irreführende Ergebnisse, wenn die Eingangsdaten fehlerhaft oder unvollständig sind.

Die Erfassungsgenauigkeit variiert zwischen verschiedenen Statistiken. Tore und Endergebnisse werden praktisch fehlerfrei erfasst, weil sie eindeutig definiert und leicht zu dokumentieren sind. Komplexere Metriken wie Passgenauigkeit oder Pressing-Intensität unterliegen Definitionsspielräumen und können je nach Erfassungssystem unterschiedlich ausfallen. Diese Inkonsistenzen können die Vergleichbarkeit von Daten aus verschiedenen Quellen beeinträchtigen.

Die historische Verfügbarkeit von Daten begrenzt die Analysemöglichkeiten. Einfache Statistiken wie Tore und Punkte sind für Jahrzehnte verfügbar, während fortgeschrittene Metriken wie xG erst seit wenigen Jahren systematisch erfasst werden. KI-Modelle, die auf diesen neueren Metriken basieren, haben eine dünnere historische Basis, was ihre Robustheit potenziell einschränkt.

Die Kontextabhängigkeit von Statistiken wird oft unterschätzt. Eine Passgenauigkeit von 85 Prozent bedeutet gegen einen tief verteidigenden Gegner etwas anderes als gegen einen pressenden. Ein xG-Wert von zwei gegen Bayern München ist beeindruckender als derselbe Wert gegen einen Abstiegskandidaten. Die bloßen Zahlen ohne Kontext können irreführend sein.

Die Aktualität der Daten ist für Prognosen entscheidend. Statistiken vom Saisonbeginn verlieren an Relevanz, wenn sich die Mannschaft durch Transfers oder Trainerwechsel verändert hat. KI-Systeme müssen entscheiden, wie stark sie historische Daten gewichten, wenn sich die Rahmenbedingungen geändert haben.

Bayesianische Ansätze in der Spielprognose

Ein wichtiges Konzept in der modernen Statistik ist der bayesianische Ansatz, der in vielen KI-Prognosemodellen Anwendung findet. Das Verständnis dieser Denkweise hilft dir, die Logik hinter fortgeschrittenen Analysen nachzuvollziehen.

Der bayesianische Ansatz kombiniert Vorwissen mit neuen Beobachtungen zu aktualisierten Einschätzungen. Vor einem Spiel hast du eine Erwartung, wie stark beide Teams sind. Diese Erwartung basiert auf allem, was du über die Mannschaften weißt. Nach dem Spiel aktualisierst du deine Einschätzung auf Basis des Ergebnisses und der Spielleistung. Die neue Einschätzung reflektiert sowohl das Vorwissen als auch die neue Information.

Für die Bundesliga-Prognose bedeutet das konkret: Ein Modell startet mit einer Einschätzung der Teamstärke, die auf historischen Daten, Kaderwerten und anderen Faktoren basiert. Mit jedem Spieltag werden diese Einschätzungen aktualisiert. Ein überraschendes Ergebnis verändert die Einschätzung, aber nicht vollständig, weil das Vorwissen ebenfalls Gewicht hat. Diese Balance zwischen Stabilität und Reaktionsfähigkeit ist ein zentrales Element guter Prognosemodelle.

Die Gewichtung von Vorwissen und neuen Daten ist eine kritische Entscheidung. Zu viel Gewicht auf dem Vorwissen macht das Modell träge und langsam in der Anpassung an Veränderungen. Zu viel Gewicht auf neuen Daten führt zu übermäßigen Reaktionen auf einzelne Ergebnisse. Die optimale Balance hängt vom Kontext ab und wird oft empirisch bestimmt.

Ein praktisches Beispiel illustriert den Ansatz. Ein Aufsteiger hat zu Saisonbeginn eine niedrige erwartete Stärke, weil er aus der zweiten Liga kommt. Wenn er die ersten fünf Spiele gewinnt, steigt seine geschätzte Stärke, aber nicht auf das Niveau eines etablierten Spitzenteams. Das Vorwissen, dass Aufsteiger typischerweise im Mittelfeld landen, dämpft die Reaktion auf die frühen Erfolge. Diese Dämpfung ist oft sinnvoll, weil frühe Saisonergebnisse stark von Zufall beeinflusst sein können.

Grenzen statistischer Prognosen

Trotz aller Fortschritte haben statistische Methoden im Fußball fundamentale Grenzen, die realistisch eingeschätzt werden sollten. Das Verständnis dieser Grenzen schützt vor überzogenen Erwartungen.

Die inhärente Zufälligkeit des Fußballs ist die grundlegendste Limitation. Ein abgefälschter Schuss, ein strittiger Elfmeterpfiff oder eine Rote Karte aus heiterem Himmel können Spiele entscheiden, ohne dass irgendeine Statistik diese Ereignisse vorhersagen könnte. Diese Zufallskomponente lässt sich nicht eliminieren, sondern nur in Wahrscheinlichkeiten ausdrücken.

Die geringe Anzahl von Toren im Fußball verstärkt die Zufallskomponente. In einem Basketballspiel mit 200 Punkten gleichen sich Zufallsschwankungen über das Spiel aus. In einem Fußballspiel mit zwei oder drei Toren kann ein einzelnes Zufallsereignis spielentscheidend sein. Diese statistische Eigenschaft macht präzise Prognosen im Fußball schwieriger als in torreicheren Sportarten.

Die begrenzte Stichprobengröße erschwert belastbare Aussagen. Eine Saison umfasst nur 34 Spieltage pro Team, und die Kader ändern sich zwischen den Saisons erheblich. Die Datenbasis für teamspezifische Analysen ist daher oft zu dünn für statistisch signifikante Schlüsse. KI-Modelle begegnen diesem Problem durch Aggregation über viele Teams und Saisons, was aber die Spezifität der Aussagen reduziert.

Die Messbarkeit relevanter Faktoren ist begrenzt. Motivation, Teamchemie, taktische Anpassungen und psychologische Faktoren beeinflussen Spielergebnisse, lassen sich aber nur schwer in Zahlen fassen. Statistiken erfassen das Messbare, nicht das Wichtige. Ein Team kann statistisch identisch aussehen und dennoch völlig unterschiedlich auftreten, weil die entscheidenden Unterschiede in nicht messbaren Faktoren liegen.

Die Veränderung der Rahmenbedingungen über Zeit macht historische Daten weniger aussagekräftig. Der Fußball von heute unterscheidet sich taktisch und athletisch vom Fußball vor zehn Jahren. Modelle, die auf alten Daten trainiert wurden, können systematische Fehler aufweisen, wenn sie Muster anwenden, die nicht mehr gelten.

Statistische Methoden kritisch hinterfragen

Die kompetente Nutzung statistischer Analysen erfordert eine kritische Grundhaltung. Zahlen wirken objektiv und überzeugend, können aber auf vielfältige Weise in die Irre führen.

Die Auswahl der Statistiken kann Ergebnisse verzerren. Wer eine bestimmte These belegen möchte, findet fast immer Zahlen, die sie stützen. Ein Team kann gleichzeitig gut und schlecht aussehen, je nachdem, welche Metriken man betrachtet. Die Frage, warum gerade diese Statistiken präsentiert werden und nicht andere, sollte immer gestellt werden.

Die Interpretation von Statistiken erfordert Kontext. Eine Passgenauigkeit von 90 Prozent kann hervorragend oder enttäuschend sein, abhängig vom Spielstil und den Anforderungen der Situation. Zahlen ohne Kontext sind oft bedeutungslos oder irreführend.

Die Darstellung von Statistiken kann manipulativ sein. Die Skalierung von Grafiken, die Auswahl von Vergleichszeiträumen und die Betonung bestimmter Aspekte beeinflussen die Wahrnehmung, ohne dass die Zahlen selbst verändert werden. Kritische Konsumenten achten auf diese Darstellungstricks.

Die Unsicherheit statistischer Aussagen wird oft verschwiegen. Eine Prognose von 55 Prozent für einen Heimsieg klingt präzise, hat aber ein erhebliches Konfidenzintervall. Die wahre Wahrscheinlichkeit könnte bei 45 oder 65 Prozent liegen. Modelle, die diese Unsicherheit nicht kommunizieren, erwecken einen falschen Eindruck von Präzision.

Praktische Anwendung statistischer Erkenntnisse

Die Umsetzung statistischer Konzepte in praktische Entscheidungen erfordert einen strukturierten Ansatz, der die Stärken der Methodik nutzt und ihre Grenzen respektiert.

Beginne mit der Frage, welche Information du suchst und welche Statistiken dafür relevant sind. Nicht jede verfügbare Zahl ist für jede Fragestellung nützlich. Die Konzentration auf wenige aussagekräftige Metriken ist oft besser als die Überflutung mit zahllosen Kennzahlen.

Vergleiche die statistischen Aussagen mit deinem eigenen Wissen und deiner Beobachtung. Wenn die Zahlen etwas Überraschendes zeigen, hinterfrage sowohl die Zahlen als auch deine Vorannahmen. Manchmal haben die Statistiken recht und die Intuition irrt, manchmal ist es umgekehrt.

Berücksichtige die Unsicherheit der Aussagen. Eine Prognose ist umso wertvoller, je mehr sie von den Markterwartungen abweicht und je solider ihre statistische Grundlage ist. Kleine Unterschiede bei hoher Unsicherheit sind weniger handlungsrelevant als größere Unterschiede bei besserer Datenlage.

Dokumentiere deine Entscheidungen und ihre Begründungen. Nach einigen Monaten kannst du auswerten, welche statistischen Ansätze für dich funktioniert haben und welche nicht. Diese Selbstreflexion verbessert deinen Umgang mit Zahlen kontinuierlich.

Verantwortungsvoller Umgang mit statistischen Prognosen

Die Verfügbarkeit statistischer Analysen kann das Gefühl verstärken, den Fußball durchschaut zu haben. Diese Illusion ist gefährlich und sollte bewusst gegengesteuert werden.

Statistik reduziert die Komplexität des Spiels auf handhabbare Zahlen und verliert dabei zwangsläufig Information. Die Zahlen erfassen Aspekte der Realität, nicht die Realität selbst. Diese Bescheidenheit im Umgang mit Daten ist angemessen.

Die Bundeszentrale für gesundheitliche Aufklärung bietet unter der Telefonnummer 0800 1 37 27 00 kostenlose und anonyme Beratung für Menschen, die ihr Spielverhalten reflektieren möchten. Wenn die Beschäftigung mit Statistiken und Prognosen mehr Raum einnimmt als beabsichtigt, ist professionelle Unterstützung verfügbar.

Statistische Analysen sind ein faszinierendes Werkzeug, das dein Verständnis des Fußballs vertiefen kann. Sie sind keine Garantie für Erfolg und sollten als Ergänzung, nicht als Ersatz für eigenes Denken verstanden werden. Mit dieser realistischen Perspektive kannst du die Möglichkeiten der Datenanalyse nutzen, ohne ihre Grenzen aus den Augen zu verlieren.